„The basic idea of OBD is that it is possible to take a perfectly reasonable network, delete half (or more) of the weights and wind up with a network that works just as well, or better.“

Yann LeCun, John S. Denker, Sara A. Solla – Optimal Brain Damage (1989)

1989 endet der Himmlische Frieden auf dem Tiananmen Platz in Beijing. An der Grenze zwischen Österreich und Ungarn durchtrennen Gyula Horn und Alois Mock den Signalzaun, im November fällt die Berliner Mauer. Der Franzose Yann LeCun ist gerade 29 Jahre alt und hat nach seinem Informatikstudium an der Sorbonne und einem PostDoc zu neuronalen Netzen bei der Deep-Learning-Koryphäe Geoffrey Hinton an der University of Toronto bei den AT&T Bell Labs angeheuert. Ein geschichtsträchtiger Ort: Hier hatte Claude E. Shannon 1948 A Mathematical Theory of Communication geschrieben, das Bit aus der Taufe gehoben und 1951 mit der „Theseus“ getauften mechanischen Maus (eigentlich Laborratte) den Grundstein für maschinelles Lernen gelegt. Geoffrey Hinton, Ururenkel des Mathematikers und Logikers George Boole, dessen sogenannter Booleschen Algebra wir mathematische Skandale wie 1+1=1 und damit auch die ontologisch verstörende Aussage „nur was schaltbar ist, ist überhaupt“ verdanken, wird 2024 mit seinem Kollegen John Hopfield gemeinsam den Nobelpreis für Physik aufgrund ihrer Leistungen im Feld des Machine Learning erhalten, womit diese bis dato krude Ansammlung statistischer und heuristischer Techniken den Rang einer Grundlagenwissenschaft erlangt. Unerlässlich, um die Kathedrale „Künstliche Intelligenz“ als solche zu errichten und darüber hinwegzutäuschen, dass es sich eigentlich nur um eine weitere Fabrik handelt.

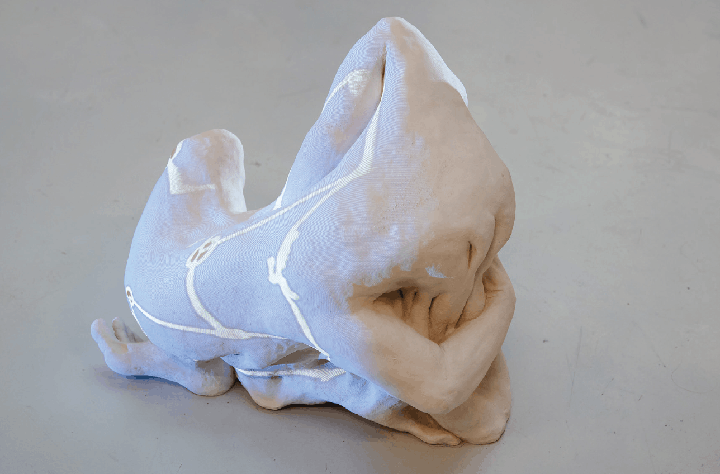

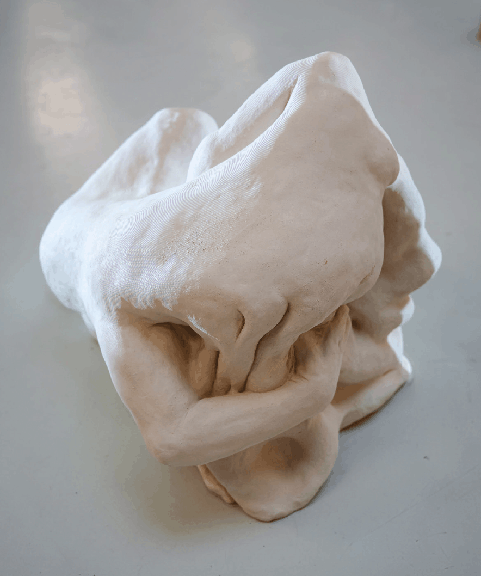

2025 merkte Hinton zu seinen mittlerweile profunden Zweifeln an den Fortschritten in der KI an: „If you want to know how it’s like not to be the apex intelligence, ask a chicken.“1 1989 jedoch arbeitet man in den AT&T Bell Labs an sogenannter Backpropagation, einer zentralen Methode des maschinellen Lernens. Der erste „Winter of AI“ ist überwunden, es gibt vielversprechende neue Ansätze, einen regelrechten Boom von Expertensystemen und dem sogenannten Konnektionismus, also künstlicher neuronaler Netze, und die Budgets wachsen erstmals in die Milliarden. Mit steigender Komplexität der Modelle und den entsprechend exponentiell wachsenden Datenmengen, die prozessiert werden, schießt auch der Bedarf an Rechenleistung durch die Decke. Yann LeCun hat dazu eine radikale Idee – eine, die an die Proto-Psychiatrie des späten 19. bzw. die Psychochirurgie des 20. Jahrhunderts in Form der berühmt-berüchtigten Lobotomie erinnert: Basierend auf einem vom sowjetischen Kybernetiker Oleksij Iwachnenko entwickelten Kompressionsverfahren veröffentlicht LeCun mit Sara Soller und John Denker ein Paper mit dem wundersam poetischen Titel Optimal Brain Damage2. Die Idee zum entsprechenden Algorithmus ist so brutal simpel wie sein Name: Ermittle, welche Gewichtungen in einem neuronalen Netz wenig zum Gesamtergebnis beitragen, und entferne sie. Lernen nicht durch Hinzufügen, sondern durch gezielte Zerstörung. Eine ökonomische Epistemologie, Optimierung durch heuristische Amputation.

Es ist nicht davon auszugehen, dass LeCun den bereits 1982 erschienenen Text Der Gott der Ohren des Medienphilosophen Friedrich Kittler gelesen hat. Darin verfolgt Kittler anhand des Pink-Floyd-Songs Brain Damage (1973) die Mediengeschichte vom griechischen Gott Pan und dessen „sonischem“ Sein bis zur psychotechnisch vollkommenen Surround-Ekstase. Die letzte Strophe von Brain Damage lautet:

„The lunatic is in my head

The lunatic is in my head

You raise the blade, you make the change

You rearrange me ’till I’m sane

You lock the door and throw away the key

And there's someone in my head, but it’s not me“

Im Vergleich passt dies deutlich besser zu LeCuns Verfahren einer Lernoptimierung qua maximalinvasiver Psychochirurgie als zu Kittlers Idee vom halluzinogenen Synthesizer als Basis einer neuen synthetischen Philosophie. „Optimal Brain Damage“ (OBD) wird in den folgenden Jahrzehnten zur selbstverständlichen Praxis im Umgang mit stetig komplexer werdenden neuronalen Netzen und später mit großen Sprachmodellen (LLMs). So selbstverständlich, dass diese stabilisierende Schockdoktrin unsichtbar wird.

Während LeCun 2012 das NYU Center for Data Science gründet, 2013 Leiter von Facebook AI Research (kurz FAIR) wird und 2018 gemeinsam mit Hinton den Turing Award erhält, etabliert sich OBD als grundlegende Technik der Modellentwicklung und -pflege. In unserem Begreifen der Welt als Wetware bzw. als Konstellation von Daten, in der Enzephalisierung des Planeten zur Denkmaschine, beginnt das Paradigma einer künstlich beschleunigten, technisch exekutierten Selektion Realität zu werden. Ein Technodarwinismus, der nicht auswählt, was überlebt, sondern definiert, was vernachlässigbar ist.

Ein wesentlicher Teil des Komplexes „Künstliche Intelligenz“ entspringt also keinen träumenden Androiden, sondern traumatisierten Systemen. „And there’s someone in my head, but it’s not me.“ In Gestalt von DOGE wird OBD später Politik und macht öffentliche Verwaltung selbst zum Material.

„Oh baby, I like it raw.“

Ol’ Dirty Bastard (ODB), 1995, vielleicht auch über Daten

Genau 20 Jahre ist es her, dass der britische Mathematiker Clive Humby mit seinem Sager „data is the new oil“ zwar die Ökonomie des frühen 21. Jahrhunderts entscheidend anzukurbeln begann, aber gleichzeitig auch einige Unklarheit stiftete. Die Materialität von Daten und den sie verarbeitenden Infrastrukturen wurden ab den frühen 1990er-Jahren von der Bildpropaganda eines ephemeren, nahezu transzendenten Neoliberalismus cachiert. Die massive Auslagerung vormals militärisch-industrieller Großrechenanlagen in eine global individualisierte PC-Landschaft funktionierte nur, solange sie nicht verstanden werden musste. Sie funktioniert deutlich besser, wenn sie auf ihr techno-magisches Potenzial baut, auf eine entkabelte, losgelöste, unheimliche Fernwirkung, die die damals aufkeimende und vorgeblich technodeterministische, materialistische Medientheorie zur Rede von einer angeblichen „Immaterialität“ der Kommunikation und Arbeit verleitete.

Auch ist es vielleicht kein Zufall, dass MTV Unplugged in ebenjener Zeit, als der kabellose Kapitalismus installiert wurde, die sanfte Veredelung jener Rockmusik vornahm, die Kittler noch als „Missbrauch von Heeresgerät“ identifiziert hatte. Angesichts der vollständigen Digitalisierung und Vernetzung der Welt konterte die Industrie mit dem Bild des ubiquitären, analogen, intimen Zuhauses. In Wirklichkeit jedoch ist nichts „unplugged“, im Gegenteil, die Verkabelung des letzten Winkels des Privaten mit einer medialen Verwertungsindustrie ist total, die Kabel liegen nur unter abgetretenen Perserteppichen, und die Aufnahme- oder Überwachungsmikrofone stecken in den dekorativen Vintage-Lampenschirmen. Ketten wie Starbucks ketteten die entkabelten Arbeiter*innen des entstehenden Überwachungskapitalismus in exakt diesen Nostalgiefallen fest, um die entfremdete, aber nunmehr allgegenwärtige und immerwährende Arbeit in den analogen Komfort der eigenen vier Wände zu kleiden.

„Der Krieg wird nicht mehr erklärt, sondern fortgesetzt“, schrieb Ingeborg Bachmann 1953 im Morgengrauen der Kybernetik, kurz bevor der Begriff „Artificial Intelligence“ aus der Taufe gehoben wird: „Das Unerhörte ist alltäglich geworden.“ Und weiter: „wenn der Feind unsichtbar geworden ist / und der Schatten ewiger Rüstung / den Himmel bedeckt.“3 Jetzt, da im Netz der 1990er-Jahre die Rechnungen des kybernetischen Kapitalismus aufzugehen beginnen, sind im Schatten ewiger Rüstung die Daten nicht roh wie die Sitten, sondern „raw“ wie bei Ol’ Dirty Bastard, im Detroit Techno oder im Grunge. Sie sprudeln ungezügelt durch Betriebssysteme: eine Ölplattform in jedem Heim, mehr noch, alle schleppen ihre Plattform mit sich herum. Unklar bleibt, ob Daten aus einer realen Welt abgezapft oder ex nihilo erzeugt werden, um diese Welt erst zu informieren und real zu machen.

In den 1990er-Jahren liegt der Fokus nicht so sehr auf der Faszination oder Teleologie des Inhalts – allerhöchstens seiner unfassbaren Masse –, sondern ganz im McLuhan’schen Sinn noch auf dem Medium selbst. Die Welt ist alles, was das Netz ist. Das Netz fängt angeblich nicht ein, sondern entbirgt uns in eine Freiheit, die wir bis dato noch nicht kannten. Es befreit uns aus den Fabriken und Büros und Ämtern und Zeitzonen und Zeitlichkeiten von Übertragungsinfrastrukturen. Das Netz besteht nicht aus seinen Maschen, sondern den Lücken dazwischen; es ist überall zugänglich und vor allem eines: konsequenz- und gesetzlos, oder wie man früher sagte: „On the Internet, no one knows you’re a dog.“4

Die Möglichkeitsbedingung der Humby’sche Datenwende ist ein massiver paradigmatischer Shift, der 2007 kulminiert: der Launch des iPhones und die damit einhergehende Überlagerung von Mobilfunknetz und Wireless, mobiler hochpotenter Datenproduktionsstätte für Fotos, Geodaten usw. Und die Einführung von Facebook und Twitter im selben Jahr.

Das geschickte Täuschungsmanöver, jedem der bald Milliarden von User*innen eine Stimme zu geben und so den Eindruck zu vermitteln, auch gehört zu werden und damit Subjekt, Individuum, Bürger*in zu sein, camoufliert jedoch die totale Subjugation unter technische Standards. Wo die gute alte Psychoanalyse erstmals eine förderbare Seele entdeckte und damit, ohne es zu merken, gleichsam auf Öl gestoßen war, waren es die Kybernetik und der Kapitalismus, die dieses zähflüssige, stinkende Rohmaterial aus seelischen Sedimenten debiler Fossilien zur Ressource erhoben, die entsprechenden Pipelines bauten und Verwertungsmechanismen erfanden, um daraus schließlich Big Data und das entsprechende Data Mining zu machen. Vorerst jedoch mussten Methoden und Produkte entwickelt werden, um mit der Unform der Daten umzugehen. Die Technik bzw. die „Kehre“, die sich schließlich einstellte, war die Emergenz von Infrastrukturen zur Information, zur Formgebung. Wo psychoanalytische Ölplattformen zwar bohren und zutage fördern, produzieren, aber nicht oder zumindest nicht schnell genug verarbeiten können, haben die heutigen sozialen Plattformen die Gleichzeitigkeit von Produktion bereits informierter Ressourcen durch ständig verfeinerte Rückkopplungen erfunden: indem wir Minenarbeiter, Grubenkanarienvögel, in die Datenminen „hineinsterbende“ zukünftige Fossilien und Endabnehmer gleichzeitig sind und unsere ständig obsolet werdenden und neu zu kaufenden Werkzeuge in Form kommodifizierter Prothesenfetische als Grabbeigaben mit uns führen. Das Ausmaß der in diesen Infrastrukturen stattfindenden menschlichen Kommunikation ist jedoch im Vergleich zur ungleich schwerer zugänglichen und verständlichen Machine-to-Machine-Kommunikation verschwindend gering. Die bereits dämmernden Diktatoren werden die sein, die nicht mehr zum Volk, sondern nur zu den Empfängern sprechen: Donald Trumps berühmtes Shibboleth „covfefe“5 diente wahrscheinlich einzig und allein dem Algorithmus.

Nightmare on LLM Street

Im Zeitalter von Large Language Models bündeln sich all diese Stränge in eine optimal „geschädigte“ heuristische Einswerdung von Modell und Welt. Die Welt wird ebenso „optimally brain damaged“ wie die sie beschreibenden und erzeugenden Systeme und Daten. Wo den Daten Taten folgen, fressen sich die Motorsägen der Mileis und Musks durch alles. Der Technofaschismus ist als solcher erkannt und angeprangert, während wir ihn durch ständige Nutzung all jener Technologien und Services finanzieren und ausbauen. Endlos tiefes Doomscrolling, mehr noch, „Gooning“ in Kriegsbildern und Epstein Files perfektioniert die OBD, nichts ist mehr Spektakel oder Verschwörung, alles ist wahr und wir sind jenseits der Pornografie und Paranoia angekommen. Die Fragen nach der toxischen Materialität und Ökologie von Daten, nach den technokolonialistischen Verschaltungen des Planeten und seiner auszubeutenden Arbeiter*innen und Ressourcen, dem geopolitischen Dasein von Technologien und vor allem der Art und Weise der Formung unserer Wirklichkeiten sind eigentlich längst alle gestellt. Was bleibt, ist eine große stumpfe Ratlosigkeit angesichts dieses „Nightmare on LLM Street“. Wie in der Horrorfilmreihe über die Figur Freddy Krueger (Alb-)Traum und Wirklichkeit so miteinander verwoben sind, dass „if you die in your dream, you die for real“, sind die Grenzen zwischen on- und offline, Daten und Taten, heute vollends aufgelöst.

Chto delat? Oder besser: Chto delete?

Zahlreiche Gegenkulturtechniken vom Hands-on-critical-Engineering über künstlerisch-kritische Protocol Art bis hin zum performativeren Glitch Feminism sind valide, verharren jedoch meist innerhalb des Akronym-Totalitarismus zwischen GAFA und MAGA. Sie sind Überlebensstrategien unter Haftbedingungen, ändern jedoch nichts an den Gesetzen und Gesellschafts- und Geistestraditionen, die uns hinter diese Gitter gebracht haben, und, mit Audre Lorde gesprochen: Niemals können die Herrschaftswerkzeuge das Haus der Herrschenden zerlegen.

Die Frage ist nicht mehr, was wir kritisieren, sondern wie wir den Spieß (und die Spießer) umdrehen. Bezeichnend ist, dass aus der kritischen Medientheorie des späten 20. und frühen 21. Jahrhunderts zwar etliche weitere Medientheorien (mit Betonung auf „-theorien“) erwachsen sind, die allesamt akademisch akzeptabel und etabliert, gesellschaftspolitisch aber weitgehend irrelevant sind, während die Tech-Industrie sich daraus die Perlen der Dunklen Aufklärung eines Nick Land und Curtis Yarvin herausgepickt hat und heiter in die Tat umsetzt. Das sogenannte medientechnische Apriori hat damit vielleicht ein unerwartetes oder doch eschatologisches Ende gefunden. Die Rechte versteht es, Theorie und Praxis harmonisch zu einem hegemonischen Doomsday Device zusammenzubauen, weil sie längst aufgehört hat, ihr eigenes Rechts-Sein zu reflektieren, während alle linke Gegentheorie eben genau das tut und dabei in endlos fragmentierter Selbstkritik zu Cantor-Staub zerfällt.

Medien verstimmen unsere Lage

Es geht am Ende also um eine technische Kunst und künstlerische Technik im Sinne einer theoretisch-praktischen poiesis, die nicht reaktiv und schlimmstenfalls reaktionär oder „neo-ludditisch“ an den Datenmaterialismus herangeht, sondern aus der Sicht der Produktionsmittel. Wer ernst nimmt, in welcher Lage wir sind, kommt am Ende nicht umhin, radikale Maßnahmen zu setzen, Kunst und Technik, ars und techne, als eins zu verstehen und sich deren Produktionsmittel anzueignen. Das heißt über kurz oder lang wahrscheinlich tatsächlich Opt-out, Open Source, Technodiversität und -souveränität, also das Nutzen bzw. Entwickeln von alternativen Werkzeugen, Plattformen, Datasets, Algorithmen und Gesichtspunkten des Gemeinnutzens, der Transparenz, Partizipation und vor allem Demokratie. Öffentliche gegen unsichtbare Hand. Gegen Kommodifizierung und für Commons. Nicht als aktivistische Geste, sondern um die Kunst und die Technik vom kapitalistischen Technofaschismus zu entkoppeln und ihr eine Funktion in der Welt zu geben, die eigentlich das genaue Gegenteil ihrer jetzigen ist. Solange eine Firma wie Palantir ihre Software in einem Atemzug als „Kunst“ und „Waffensystem“ verkauft6 und ihr radikaler CEO Alex Karp seinen kriegstreibenden Konzern eine „artists’ colony, not a factory“7 nennt, ist es notwendig, nicht nur unsere Kunst neu zu denken, sondern auch die Institutionen und Infrastrukturen, die sie umgeben, untermauern und unterwandern. Wo generative KI sich rasant unsere Einbildungskraft einverleibt und in Trainingsdaten transformiert, weswegen wir uns – mit Mark Fisher – das Ende der Welt leichter vorstellen können als das Ende des Kapitalismus, braucht es neue kunstinstitutionelle Impulse in vielerlei Richtungen. Wo der Krieg der Vater aller Dinge ist, let’s be the Mothers of Invention.

[1] Geoffrey Hinton, in: Humans „no longer needed“ – Godfather of AI, interviewed by Guyon Espiner, RNZ, 27. Mai 205; https://www.youtube.com/watch?v=uuOPOO90NBo, Minute 29–30.

[2] Erschienen in: Advances in Neural Information Processing Systems 2 (NIPS 1989).

[3] Ingeborg Bachmann, Alle Tage, in: dies., Die gestundete Zeit. Frankfurt am Main 1953.

[4] Cartoon von Peter Steiner in The New Yorker, 1993.

[5] Trump auf Twitter, 31. Mai 2017: „Despite the constant negative press covfefe“.

[6] https://www.palantir.com/

[7] Laudatio auf Alex Karp anlässlich der Verleihung des Herman Kahn Awards, 11. November 2025; https://www.hudson.org/events/palantir-ceo-alex-karp-receives-hudson-institutes-2025-herman-kahn-award.